ポイント

- Stable LM 2 1.6B は、英語、スペイン語、ドイツ語、イタリア語、フランス語、ポルトガル語、オランダ語の多言語データで学習された、最新の16億パラメータ小型言語モデルです。

- このモデルのコンパクトなサイズとスピードは、ハードウェアの障壁を下げ、より多くの開発者が生成AIのエコシステムに参加できるようにします。

- プリトレーニング済み、およびインストラクションチューニング済みのバージョンに加え、プリトレーニングの収束前の最後のチェックポイントをリリースします。開発者が微調整や実験を行いやすいように、最適化関数の状態も含んでいます。データの詳細については、次回のテクニカルレポートで紹介します。

- Stable LM 2 1.6Bは、Stability AI メンバーシップ にご参加いただくと商用でご利用いただけます。またHugging Face でテストしていただけます。

新しい Stable LM 2 シリーズから16 億パラメータのベースモデル とインストラクションチューニングバージョンをご紹介します。ベースモデルは、英語、スペイン語、ドイツ語、イタリア語、フランス語、ポルトガル語、オランダ語の多言語データを取り入れ、約2兆トークンを2エポック学習します。このモデルは、言語モデリングにおける最近のアルゴリズムの進歩を活用し、速度と性能の好バランスを実現しました。

このリリースでは、コミュニティが同様のパフォーマンスを持つモデルを再現できるように、データの詳細も公開されます。これに伴い最適化関数の状態を含む、収束前の最終的なプリトレーニングチェックポイントを公開し、開発者がスムーズにプリトレーニングとデータの微調整を続けられるようにします。近日中に、私たちが実施したデータ・ミックスとトレーニングの手順についての包括的なテクニカル・レポートを公開する予定です。

モデルモデルパフォーマンス

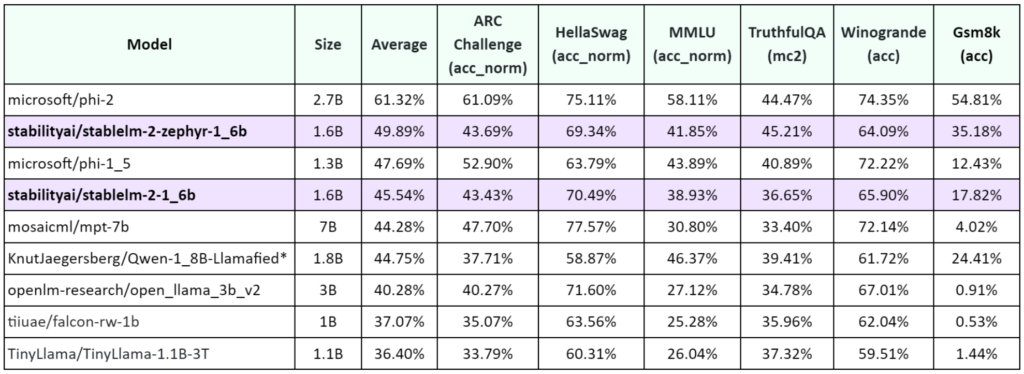

Stable LM 2 1.6B を、Microsoft の Phi-1.5(1.3B)、Phi-2(2.7B)、TinyLlama 1.1B、Falcon 1B など、他の一般的な小規模言語モデルと比較します。また、Open LLM Leaderboardに掲載されている一般的なベンチマークのテストでは、コンパクトなサイズとスピードを実現しています。

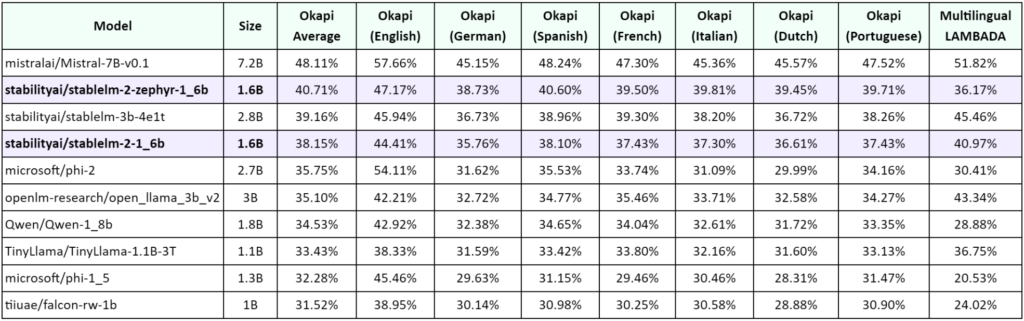

多言語テキストに対する明示的なトレーニングのおかげで、ARCチャレンジ、HellaSwag、TruthfulQA、MMLU、LAMBADAの翻訳版におけるパフォーマンスは、Stable LM 2 1.6Bが他のモデルを大きく上回っています。

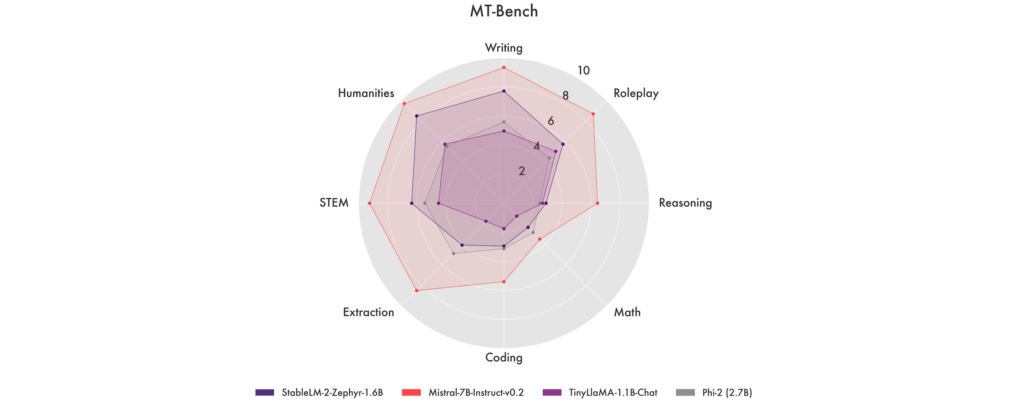

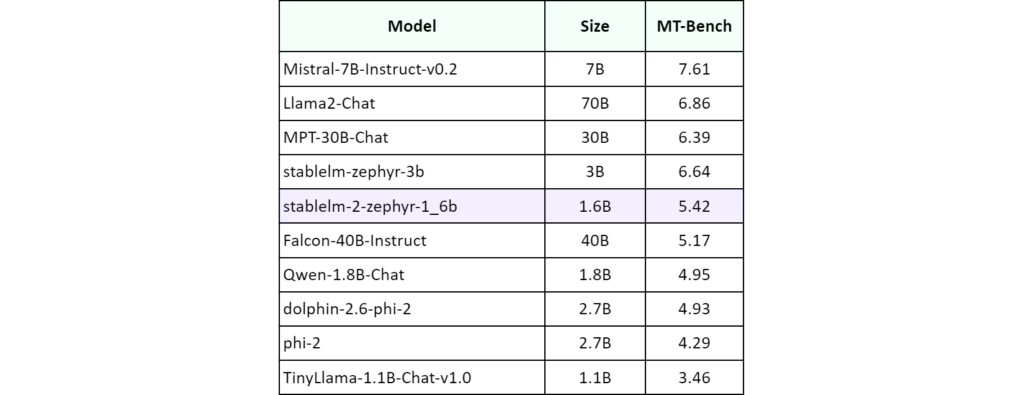

MT Bench の結果によると、Stable LM 2 1.6Bは競争力のある性能を示し、非常に大きなモデルに匹敵するか、それを上回ることもあります。

これまでで最も強力な小型言語モデルのひとつをリリースし、そのトレーニングの詳細について完全な透明性を提供することで、開発者やモデル作成者が迅速に実験や反復を行えるようにすることを目的としています。Stable LM 2 1.6B は、小型で低容量の言語モデルという性質上、高いハルシネーション率や潜在的な毒性言語といった一般的な問題を示す可能性があることに留意することが重要です。コミュニティがアプリケーションを開発する際には、このことを念頭に置き、責任ある開発を行うための適切な手段を講じるようお願いします。

商用利用と非商用利用について

Stable LMシリーズの第一弾であるStable LM 2 1.6Bは、 Stability AI メンバーシップメンバーシップの一部です。このメンバーシップには3つの階層があり、個人から企業まで、誰もがこのテクノロジーを利用できるようになっています。詳しくはメンバーシップページをご覧ください。

引用