NECは、Generative AI(生成AI)における日本語大規模言語モデル(Large Language Model、以下LLM)を開発しました。

本LLMは独自に収集・加工した多言語データを利用し、NECが開発した汎用的なモデル、いわゆるファウンデーションモデル(注1)です。独自の工夫により高い性能を実現しつつパラメータ数を130億に抑えた本LLMは、消費電力を抑制するだけでなく、軽量・高速のためクラウド/オンプレミス環境での運用が可能となります。性能面では、日本語の知識量や文書読解力を計測する日本語の一般的なベンチマーク(注2)で、世界トップクラスの日本語能力を実現しています。

NECでは本LLMをすでに社内業務で活用を始めており、文書作成や社内システム開発におけるソースコード作成業務など、様々な作業の効率化にも応用しています。

昨今、「ChatGPT」を始めとする生成AIが世界的に注目を集めており、様々な業界で急速に活用が進んでいます。一方、既存のLLMのほとんどは英語を中心に学習されており、高い日本語性能を有しつつ、各業種の業務で活用するためのカスタマイズが可能なLLMはほぼない状況です。

今回、NECは自社でLLMを開発することにより、ビジネス活用をより加速させ、企業の生産性向上に寄与します。

NECのLLMの特長

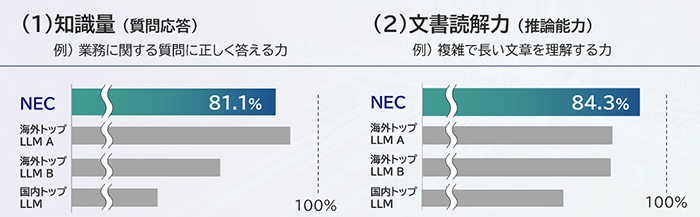

1. 高い日本語能力

LLMを実際の業務で利用するには、日本語に関する知識量及び文書読解力の点で高い性能が求められます。自然言語処理分野で標準的なベンチマークである日本語言語理解ベンチマークJGLUEを用いてNECが評価(注3)したところ、本LLMは、現時点で知識量に相当する質問応答で81.1%、推論能力に相当する文書読解においては84.3%と世界トップレベルの性能を達成しています。様々な業種における業務で十分な機能を発揮すると期待されます。

2. 軽量

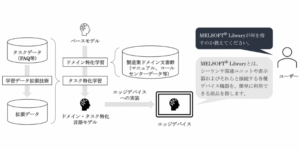

本LLMは高い性能を有しながらもNEC独自の技術により130億とモデルサイズをコンパクトに抑えています。高い性能を有するこれまでのLLMが多数のGPUを必要とするのに対し、本LLMはGPU1枚搭載の標準的なサーバで動作可能です。これにより、LLMを組み込んだ業務アプリケーションがレスポンス良く動作し、業務運用時の電力消費やサーバコストを抑えることができます。さらに、お客様の業務に特化させたLLMが短期間で容易に構築可能であることに加え、お客様のオンプレミス環境でも動作可能なため、秘匿性の高い業務においても安心です。

各LLMの特徴の1つとしてパラメータサイズの大小が用いられることが多々あります。一方、パラメータのサイズを増やすことは、推論速度の低下やモデル運用に必要なGPU枚数や消費電力の増加に繋がるため、同一の性能であればパラメータ数は少ないことが望まれます。今回NECはLLMの性能がパラメータサイズの他にも、学習に使われた高品質なデータの量や学習時間に左右される(注4)ことに着目しました。パラメータサイズをGPU1枚で動作する範囲に抑えた上で、多量のデータと膨大な計算時間をかけることで、高い性能を実現しました。NECは、国内企業で最大のAI研究用スーパーコンピュータを独自構築し、2023年3月に全面稼働を開始しています(注5)。これを活用することで、約1ヶ月という短期間で高性能なLLMの構築を実現しました。

NECは今後、ファウンデーションモデルをもとに、お客様のクローズドデータを用いた個社向けLLMの開発を強力に推進します。また、ファウンデーションモデル自体の性能改良も進め、これらの技術を NEC Generative AI Hubを通じて早期実用化して行く予定です。

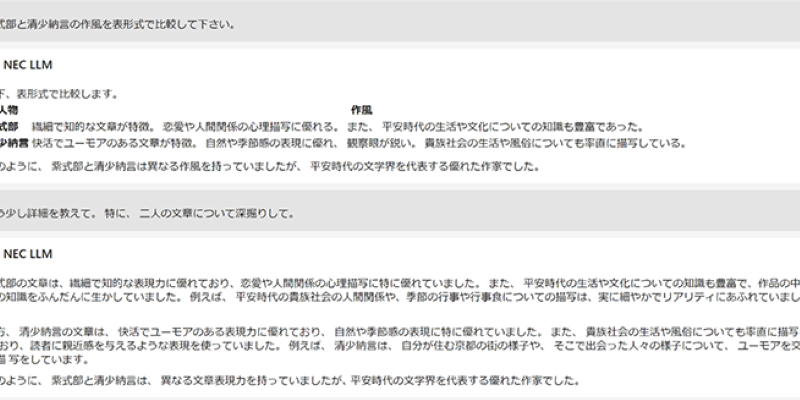

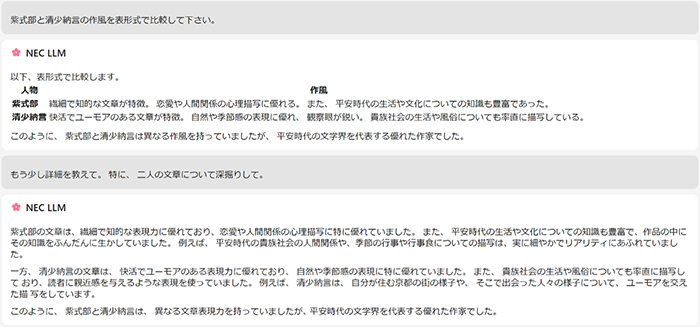

NECのLLMの実行例

以上

- (注1)ファウンデーションモデル:

Foundation model(基盤モデル)。大量のデータを使った学習(一般的には事前にラベル付けのないデータによる自己教師あり学習)により構成された機械学習モデル。 - (注2)日本語の一般的なベンチマーク:

日本語言語理解ベンチマークJGLUE。2022年6月に早稲田大学河原研究室とヤフー株式会社の共同研究により構築・公開したベンチマーク。 - (注3)質問応答についてはJCommonSenseQAタスクを実施。教師データによるFine-tuneは実施せず、推論時に少数の例示をおこなうIn-Context Learningの設定で各LLMに3事例を与えて予測をさせて結果を評価。文書読解についてはJSQuADタスクを実施し、In-Context Learningの設定で事例数は2とした。評価指標としてはExact Matchスコアを用いた。「国内トップLLM」のスコアは、国内の公開LLMモデル複数についてはNECが実施した試験結果を、非公開モデルについては同一設定で実験している論文の結果を合わせて、そのうち最高性能のものを選択。

- (注4)Scaling-Lawと呼ばれる法則。

- (注5)AI研究用スーパーコンピュータ:

NEC、国内企業で最大規模となるAI研究用スーパーコンピュータを稼働開

NECが開発したLLMについて

URL:http://jpn.nec.com/rd/technologies/202308/index.html

NEC Generative AI Serviceについて

URL:https://jpn.nec.com/LLM/index.html

本件に関するお客様からのお問い合わせ先

お問い合わせは以下WEBサイトの「お問い合わせタブ」もしくは「お問い合わせボタン」からご連絡ください。

URL:https://jpn.nec.com/LLM/index.html

引用