マルチコアCPU/GPU/FPGAを用いた高速化技術のグローバルリーダーである株式会社フィックスターズ(東証プライム:3687、代表取締役社長 CEO:三木 聡)は、企業が効率的に大規模言語モデル(Large Language Models、LLM)の研究開発を行えるクラウドサービス「Fixstars K4」の販売を開始しました。本サービスの提供では、フィックスターズの強みである、ソフトウェアの高速化技術と、GPUを活用したAI関連ソフトウェアの開発環境整備の知見を活かしています。

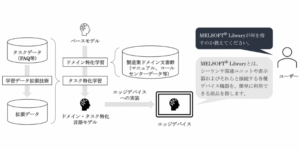

企業が業務適用を目的としたLLMを開発する際に必要な、高効率な開発基盤をワンストップで提供し、LLMの開発を円滑に、かつ効率的に進められる環境を実現します。お客様は、本サービスを利用することで、企業内に眠る知識資産や固有のデータをAIに取り込むなど、その企業向けにカスタマイズした専用AIの研究開発や業務適用を迅速に行うことが可能になります。

企業固有のデータ活用とLLM研究開発の課題

生成AIの汎用的なアプリケーションの試験導入が進む一方で、固有のニーズに特化した知識をAIに学習させ、精度を改善していくことの重要性が注目されています。この初期段階として、業務適用を目指したLLMの研究開発プロジェクトが多く立ち上がっています。

業務適用を目的としたLLMを開発する場合、膨大な量のデータを高速処理する大量の計算資源の個別調達が必要になります。そして計算に必要な高性能GPUは高価で入手困難なため、プロジェクトの大きな障壁となりがちです。また、応答品質を向上させるための試行錯誤には時間がかかり、期待する開発成果を得る難易度が上がる理由になっています。この試行錯誤の時間を短縮して試行回数を増やすためには、新たな開発ツールの導入や処理速度の向上によるプロセス効率化が必要です。一方でこのような効率化に工数を割くと、LLM自体の研究開発に注力する時間が削がれます。

企業が固有のデータをAI学習に利用するプロジェクトでは、セキュリティ確保の観点でデータ格納や情報漏洩リスクへの個別対応が求められます。この場合、考慮すべきセキュリティ項目が多い共有サーバーよりも、個別にアクセス制限や運用ルールを適用できる専有サーバーの方が、安全で利便性の高い環境での研究開発をすぐに始められます。

結果として、これらの開発環境整備に関する課題を工数をかけずに解決することが、研究開発プロセスを短縮し、専用AIの開発を高速に進める鍵となります。

企業固有のデータ活用とLLM研究開発の課題

生成AIの汎用的なアプリケーションの試験導入が進む一方で、固有のニーズに特化した知識をAIに学習させ、精度を改善していくことの重要性が注目されています。この初期段階として、業務適用を目指したLLMの研究開発プロジェクトが多く立ち上がっています。

業務適用を目的としたLLMを開発する場合、膨大な量のデータを高速処理する大量の計算資源の個別調達が必要になります。そして計算に必要な高性能GPUは高価で入手困難なため、プロジェクトの大きな障壁となりがちです。また、応答品質を向上させるための試行錯誤には時間がかかり、期待する開発成果を得る難易度が上がる理由になっています。この試行錯誤の時間を短縮して試行回数を増やすためには、新たな開発ツールの導入や処理速度の向上によるプロセス効率化が必要です。一方でこのような効率化に工数を割くと、LLM自体の研究開発に注力する時間が削がれます。

企業が固有のデータをAI学習に利用するプロジェクトでは、セキュリティ確保の観点でデータ格納や情報漏洩リスクへの個別対応が求められます。この場合、考慮すべきセキュリティ項目が多い共有サーバーよりも、個別にアクセス制限や運用ルールを適用できる専有サーバーの方が、安全で利便性の高い環境での研究開発をすぐに始められます。

結果として、これらの開発環境整備に関する課題を工数をかけずに解決することが、研究開発プロセスを短縮し、専用AIの開発を高速に進める鍵となります。

商品開発の背景とFixstars K4の特長

フィックスターズは、LLMの学習と推論を高いコストパフォーマンスで実現できる開発基盤の整備に向けて、さくらインターネットと共同で研究開発[※]を進めています。各社固有のデータを取り扱う専用LLMを高効率で開発・運用できるこの開発基盤では、フィックスターズの高速化技術を適用したLLM開発用ソフトウェアと、GPUサーバーを始めとするハードウェアが一体となり、LLMのための高効率な開発基盤を構成しています。

Fixstars K4は高速性・利便性・安全性を備える、LLMの研究開発に特化したクラウドサービスです。NVIDIA社製 H100を8枚搭載した強力な専有GPUサーバーと、即時にモデル開発を開始できるミドルウェア群をセットアップし、AIモデルの統合的な開発環境として提供します。この開発環境には、フィックスターズが長年培ってきた高速化技術を適用した開発ツール群が導入されており、LLM研究開発の効率化を強力に支援します。

開発基盤の利用サポートも含めて月額350万円からの価格帯で、個別の要望に応じてコンサルティングサービスも提供します。

Fixstars K4は、LLM開発の根幹となるハードウェアの性能を効果的に引き出すことに着目した、革新的なソリューションです。研究開発活動を加速させ、AI技術活用の効果検証を早め、企業のデジタル変革を支援します。

今後もフィックスターズは、お客様の事業環境で求められる、最先端技術を取り入れたサービスをいち早く提供し、産業界の発展に貢献してまいります。

関連情報

Fixstars K4 商品紹介サイト

https://www.fixstars.com/ja/llm/k4/

[※]フィックスターズが大規模言語モデル(LLM)開発環境を高速化するための研究開発に着手https://news.fixstars.com/3756/

株式会社フィックスターズについて

フィックスターズは、”Speed up your Business”をコーポレートメッセージとして掲げるテクノロジーカンパニーです。マルチコアプロセッサを効率的に利用するためのソフトウェアの並列化および最適化と、省電力かつ高速IOを実現する新メモリ技術を活用したアプリケーションの高速化を通じて、医療、製造、金融、エンターテインメントなど、様々な分野のお客様のビジネスを加速し、グリーンITを実現しています。

https://www.fixstars.com/ja/

報道関係のお問い合わせ

株式会社フィックスターズ 広報担当

Email:press@fixstars.com

Tel:03-6420-0751

引用